(antal aktiva besökare uppdateras automatiskt var 4:e minut)

Om du vill informera om att denna webbsida finns...

Den här webbsidan beskriver signifikansnivå och hur det förhåller sig till p-värden. Dessa begrepp blandas ibland ihop, och genom att läsa den här sidan kommer du att förstå skillnaden. Sidan innehåller även onlinekalkylatorer till din hjälp.

Du kommer att förstå innehållet bäst om du först har läst Introduktion till statistik och Analytisk statistik.

Skillnaden mellan signifikansnivå (alfa) och p-värdet

(Nedanstående video är på engelska. Om du har svårt att förstå engelska kan du få svensk text genom att klicka på “YouTube” (i nedre högra hörnet) för att gå till YouTube där videon automatiskt startar. I YouTube klickar du på kugghjulsikonen, sedan klicka på “Subtitles”, klicka sedan på auto-translate och välj svenska. Detta fungerar någorlunda bra men det kan bli en del felaktigheter i översättningen).

Ett lågt p-värde indikerar att det är högst osannolikt att vi skulle se vår data om den effekt eller det samband vi letar efter i själva verket vore noll. Med andra ord tillåter ett lågt p-värde oss att förkasta nollhypotesen till förmån för den alternativa hypotesen. Men exakt hur lågt måste p-värdet vara för att vi ska kunna ta detta steg? Detta gränsvärde bör bestämmas från fall till fall och kallas för signifikansnivå, eller alfa.

Vi använder analytisk statistik för att beräkna ett p-värde. Nästa steg är att jämföra detta beräknade p-värde med vår förutbestämda signifikansnivå (alfa). Om p-värdet är lägre än alfa förkastar vi nollhypotesen och anser att den alternativa hypotesen är den mest sannolika. Om p-värdet omvänt är högre än alfa kan vi inte förkasta nollhypotesen; våra resultat ger inte tillräckligt med bevis för att motsäga den.

Av tradition sätts alfa oftast till ≤0,05. Därför skulle ett p-värde på 0,045 klassificeras som statistiskt signifikant, medan ett p-värde på 0,055 inte skulle göra det. Det är dock viktigt att komma ihåg att denna gräns på ≤0,05 inte är svartvit. I verkligheten är resultaten för p=0,045 och p=0,055 statistiskt sett väldigt lika. På grund av detta bör exakta p-värden alltid redovisas, istället för att bara ange om ett fynd var “signifikant” eller inte.

Sammanfattningsvis: Signifikansnivån (alfa) är en fast gräns som bestäms av forskaren, vanligtvis i förväg. Den beror inte på våra observationer och beräknas inte; det är snarare ett medvetet beslut baserat på den säkerhetsmarginal som behövs för att undvika att begå ett typ I-fel (ett falskt positivt resultat). P-värdet å andra sidan beräknas direkt utifrån – och beror helt och hållet på – vår observerade data.

Signifikansnivå och ren slump

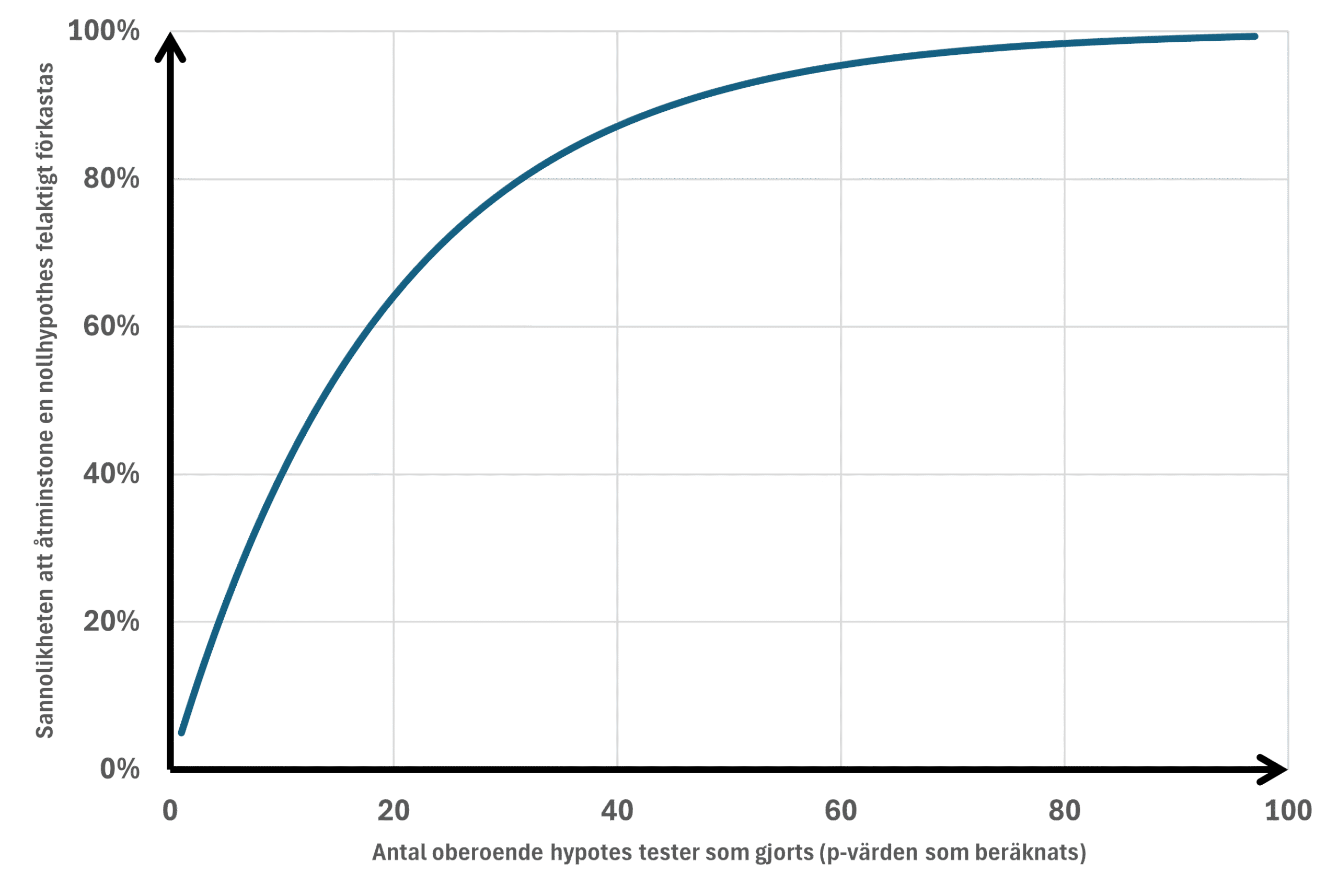

Anta att vi vill veta vilka variabler som skiljer sig åt mellan två grupper: de som har haft en sjukdom jämfört med de som inte har haft det (eller så kan det vara de som svarar ja på en fråga jämfört med de som svarar nej). Anta också att vi vill undersöka 50 olika variabler, varav vissa är kategoriska medan andra är kontinuerliga. Att använda chi-två-test eller t-test för att jämföra de två grupperna skulle resultera i 50 p-värden, vissa under och vissa över 0,05. Ett p-värde ≤0,05 kan dock uppstå av ren slump utan att det representerar en verklig skillnad mellan grupperna. Sannolikheten att felaktigt förkasta nollhypotesen (att tro att ett lågt p-värde representerar något annat än ren slump) ökar ju fler test vi gör (Figur 1).

Att bestämma signifikansnivån

För att kompensera för risken att få statistisk signifikans av ren slump när vi gör multipla tester måste vi sänka gränsen för när vi anser att ett statistiskt fynd är signifikant, så snart vi presenterar mer än ett p-värde. Det finns olika metoder för att göra detta.

Family-Wise Error Rate (FWER) och False Discovery Rate (FDR)

Family-Wise Error Rate (FWER) är sannolikheten att begå minst ett typ I-fel – det vill säga minst ett falskt positivt resultat – över en samling statistiska tester. Enklare uttryckt: Om du utför flera hypotesprövningar är FWER risken att en eller flera av dem felaktigt framstår som statistiskt signifikanta av ren slump (Figur 1). Formeln är 1 – (1 – α)^m (där m = antalet statistiska tester). Till exempel, om vi gör 20 statistiska tester är risken att begå minst ett typ I-fel:

I det här exemplet skulle det vara 64 % risk att minst ett statistiskt test blir falskt positivt. FWER handlar om att kontrollera sannolikheten för att göra någon sådan falsk upptäckt i hela uppsättningen av tester. FWER är striktare än False Discovery Rate (FDR):

- FWER kontrollerar risken att få något falskt positivt resultat.

- FDR kontrollerar den förväntade andelen falska positiva resultat bland de statistiskt signifikanta fynden.

Översikt över “universella justerare” av signifikansnivån

| Metod | Beskrivning | Fördelar | Nackdelar |

|---|---|---|---|

| Bonferroni-metoden | Kontrollerar Family-Wise Error Rate (FWER). Håller risken att få ens ett enda falskt positivt resultat på exakt 5 % (eller din valda signifikansnivå). Använd aldrig denna metod (det är bättre att använda någon av de rekommenderade metoderna nedan). | Mycket enkel att förstå. Kräver inte att varje test är oberoende. | “Mycket konservativ”, vilket gör det svårt att hitta statistisk signifikans om du beräknar många p-värden. |

| Dunn-Šidáks korrektion | Kontrollerar Family-Wise Error Rate (FWER). Håller risken att få ens ett enda falskt positivt resultat på exakt 5 % (eller din valda signifikansnivå). Använd aldrig denna metod (det är bättre att använda någon av de rekommenderade metoderna nedan). | Något mindre konservativ än Bonferronimetoden. Skillnaden är dock mycket liten och denna metod kommer sannolikt, precis som Bonferronimetoden, att missa relevanta fynd. | Mindre enkel att förstå. Kräver dessutom att vart och ett av dina 20 tester är helt oberoende av de andra (vilket ofta inte är fallet i verkligheten).. |

| Holm-Bonferroni metoden | Kontrollerar Family-Wise Error Rate (FWER). Håller risken att få ens ett enda falskt positivt resultat på exakt 5 % (eller din valda signifikansnivå). Lämplig för konfirmerande forskning. | Mindre konservativ jämfört med Bonferronimetoden, vilket innebär att chansen att hitta en sann statistisk signifikans är högre än om du använder Bonferronimetoden. Kräver inte att varje test är oberoende. | Den är fortfarande relativt konservativ. Om du gör hundratals tester kommer den fortfarande att eliminera många potentiellt giltiga fynd. |

| Benjamini-Hochberg proceduren | Istället för att kontrollera risken för att få något falskt positivt resultat, kontrollerar denna metod False Discovery Rate (FDR). Det innebär att den accepterar en liten, känd andel falska positiva resultat i utbyte mot en mycket högre chans att upptäcka sanna signifikanta skillnader. Lämplig för explorativ forskning. | Betydligt mer statistisk styrka (power) än någon av metoderna ovan. Det är guldstandarden för explorativ dataanalys där du screenar dussintals eller hundratals variabler för att se vad som verkar lovande. Du använder BH när du vill kasta ut ett brett nät för att hitta uppslag för framtida, mer riktad forskning. Detta är det bästa tillvägagångssättet när man beräknar många p-värden (>20?). Kräver inte att varje test är oberoende. | Du kommer att få några falskt positiva p-värden. |

Bonferroni-metoden

Denna enkla metod innebär att vi dividerar den önskade övergripande signifikansnivån (ofta 0,05) med antalet beräknade p-värden. I ett exempel med 50 beräknade p-värden innebär en Bonferroni-justering att endast p-värden ≤0,001 ska betraktas som statistiskt signifikanta, vilket kan vara svårt att uppnå. Därför är Bonferronimetoden inte lämplig om du beräknar många p-värden. Prestandan hos Holm-Bonferronimetoden eller Benjamini-Hochberg-proceduren är mycket bättre, så använd någon av dessa istället.

Dunn-Šidáks korrektion

Dunn-Šidák-korrektionen (eller helt enkelt Šidák-korrektionen) är, precis som Bonferronimetoden, en historisk fotnot. Prestandan hos Holm-Bonferronimetoden eller Benjamini-Hochberg-proceduren är mycket bättre, så använd någon av dessa istället.

Holm-Bonferroni metoden

Kontrollerar Family-Wise Error Rate (FWER) precis som den vanliga Bonferronimetoden, vilket innebär att den håller risken att få ens ett enda falskt positivt resultat på exakt 5 % (eller ditt valda alfa). Istället för att behandla varje test på samma sätt använder Holm-Bonferroni en “stegvis” (step-down) metod. Det är i grunden en smartare och mindre bestraffande version av standard-Bonferroni-korrektionen. Proceduren går till steg för steg:

- Rangordna dina p-värden: Sortera alla dina p-värden från det minsta (mest signifikanta) till det största (minst signifikanta).

- Tillämpa ett glidande gränsvärde: Istället för att dividera din alfa (exempelvis 0,05) med det totala antalet utförda tester för varje enskilt test, ändras gränsvärdet beroende på p-värdets rang. Formeln för det justerade gränsvärdet för det i:te rangordnade p-värdet är:

Gränsvärde = alfa / (m – i + 1)

(Där alfa är 0,05, m är det totala antalet beräknade p-värden, och i är p-värdets rang). - Stegvis nedåt (The Step-Down): För ditt minsta p-värde är gränsvärdet exakt detsamma som det som räknas fram vid standard-Bonferroni. Om ditt p-värde är lika med eller under detta är det signifikant. För ditt näst minsta p-värde blir gränsvärdet något lättare att uppnå jämfört med det som Bonferronimetoden räknar fram. Du fortsätter sedan nedåt på listan. Gränsvärdet blir större (lättare att uppnå) jämfört med Bonferroni metodens framräknade gränsvärde för varje steg. Så fort du stöter på ett p-värde som är större än dess beräknade gränsvärde, stannar du. Den variabeln, och alla variabler efter den på listan, förklaras som statistiskt icke-signifikanta.

I en “Step-Down”-procedur som Holm-Bonferroni fungerar p-värdena som en serie grindar. För att nå den sista grinden måste du först ha tagit dig igenom alla föregående grindar. När kalkylatorn stöter på det första icke-signifikanta värdet så stänger den dörren helt. Enligt reglerna för Holm-Bonferroni deklareras då det p-värdet och alla efterföljande p-värden som icke-signifikanta – oavsett hur små de är i förhållande till sina egna teoretiska gränsvärden. Detta är själva “straffet” i Holm-Bonferroni: om en länk i kedjan brister, så faller resten av testerna med den för att skydda mot falska positiva resultat.

Holm-Bonferroni kalkylator

Benjamini-Hochberg proceduren

Kontrollerar False Discovery Rate (FDR). Detta är ett massivt skifte i statistisk filosofi. Istället för att försöka garantera noll falska positiva resultat accepterar BH-proceduren att falska positiva resultat kommer att inträffa. Dess mål är att kontrollera den procentuella andelen av dina “signifikanta” fynd som faktiskt är falska. Om du ställer in din FDR på ≤0,05 betyder det: “Av alla variabler jag förklarar signifikanta idag, är det okej för mig att 5 % av dem är falskt positiva resultat.” Proceduren går till steg för steg:

- Rangordna dina p-värden: Sortera dem från det minsta överst till det största längst ner på listan.

- Beräkna ett kritiskt värde för varje p-värde: Gränsvärdet växer mycket snabbare än i Holm-Bonferronimetoden. Formeln är:

Kritiskt värde = (i / m) * Q

(Där i är rangen, m är det totala antalet beräknade p-värden, och Q är din valda False Discovery Rate, vanligtvis 0,05). - Stegvis uppåt (The Step-Up): Du tittar på din lista och hittar det största p-värdet som är mindre än dess motsvarande kritiska värde. Den variabeln, och alla variabler som är rangordnade under den (med ett mindre p-värde), förklaras som statistiskt signifikanta.

Benjamini-Hochberg kalkylator

Tips om vilken justeringsmetod man bör använda

- Använd aldrig den vanliga Bonferroni-korrektionen. De andra metoderna är alltid bättre.

- Att ha ett litet antal tester (som 5, 10 eller 15) innebär vanligtvis att du har specifika, förplanerade hypoteser. Du “fiskar” inte efter data; du försöker bekräfta specifika teorier. I dessa fall vill du ha ett strikt skydd mot falska positiva resultat, så Holm-Bonferroni (som kontrollerar FWER) är det rätta valet. Använd Holm-Bonferroni när du bedriver konfirmerande forskning. Om ett falskt positivt resultat skulle leda till att man ändrar en klinisk riktlinje, godkänner ett värdelöst läkemedel eller gör ett definitivt påstående i en tidskrift med hög impact, måste du använda Holm-Bonferroni för att garantera att den sammanlagda risken för att få ett eller flera falskt positiva resultat begränsas till 5 %. Även om du har 30 p-värden måste du, om insatserna är höga, acceptera den minskade statistiska styrkan och använda Holm-Bonferroni.

- Använd Benjamini-Hochberg när du bedriver explorativ forskning. Om ditt mål helt enkelt är att hitta “variabler av intresse” för att testa dem igen i en framtida, mer riktad studie, är Benjamini-Hochberg perfekt. Du accepterar en False Discovery Rate på 5 % eftersom ett falskt positivt resultat här bara innebär ett visst slöseri med tid i nästa studie, inte ett katastrofalt fel i verkligheten. Du kan använda BH även om du bara har 12 p-värden, så länge ditt mål är rent explorativt. När du går över till 20, 50 eller 100+ p-värden går du vanligtvis in i området för explorativ forskning (t.ex. screening av dussintals gener, biomarkörer eller demografiska variabler). I explorativ forskning är Benjamini-Hochberg (som kontrollerar FDR) absolut det rätta valet eftersom du vill kasta ut ett brett nät och inte vill att ett strikt FWER-straff ska dölja värdefulla uppslag.

Om du gör 100 tester och använder Holm-Bonferroni med alpha = 0,05, så är målet att du i 95 fall av 100 ska ha noll falska positiva. Om du däremot använder Benjamini-Hochberg (FDR) på 5 %, så accepterar du att ca 5 % av de resultat du kallar signifikanta faktiskt är falska. Skillnaden i stränghet är alltså enorm!

Scheffés metod och Tukeys HSD

Dessa är metoder för uppföljning (post-hoc-tester) av en ANOVA. Om ANOVA-testet ger ett signifikant p-värde (vilket betyder att minst en grupp skiljer sig från de andra) kör du Tukey eller Scheffé för att ta reda på exakt vilka grupper som driver den skillnaden. Du är inte begränsad till enkla parvisa jämförelser (t.ex. Grupp A mot Grupp B). Du kan jämföra genomsnittet av Grupp A och B mot Grupp C. Metoderna hanterar olika urvalsstorlekar mellan grupper utmärkt. Dessa tillvägagångssätt är skräddarsydda för gruppjämförelser och är inte “universella justerare” av signifikansnivån.

Upprepad testning över tid av samma utfall

Medan Holm-Bonferroni och Benjamini-Hochberg är dina standardmetoder för att testa dussintals variabler samtidigt i slutet av en studie, är O’Brien-Fleming-gränsen eller Pocock-gränsen metoder för att testa en enda primärvariabel vid olika tidpunkter medan en studie fortfarande pågår. Det typiska exemplet är interimsanalyser av interventionsstudier. Interimsanalyser skapar exakt samma problem med Family-Wise Error Rate (FWER) som vi diskuterade tidigare. Om du testar dina data på en 0,05-signifikansnivå år 1, år 2, år 3, år 4 och år 5, ökar din totala risk för ett falskt positivt resultat till omkring 14 %. Du “fiskar” i praktiken efter ett signifikant resultat genom att kontrollera data upprepade gånger. För att hålla den totala felmarginalen på 5 % måste du “spendera” ditt alfa (din signifikansnivå på 0,05) försiktigt över dessa olika kontroller.

Pocock-gränsen sänker signifikansnivån och håller den konstant under studien. Samma signifikansnivå tillämpas vid varje interimsanalys. Om data till exempel analyseras fyra gånger (vid 25 %, 50 %, 75 % och 100 % av insamlade observationer) sätts signifikansnivån till 0,015.

O’Brien-Fleming-metoden är en alfa-spenderande funktion (alpha-spending function). Den dikterar exakt vad ditt p-värdes-tröskelvärde måste vara vid varje interimskontroll. Dess främsta kännetecken är att den gör det otroligt svårt att avbryta en studie i förtid, men den lämnar det slutliga tröskelvärdet nästan helt oförändrat. Om du planerar 4 kontroller av data (3 interimsanalyser och 1 slutanalys), ser O’Brien-Flemings p-värdesgränser ungefär ut så här:

- Koll 1 (25 % av data): p-värdet måste vara ≤ 0,00001 för att avbryta i förtid.

- Koll 2 (50 % av data): p-värdet måste vara ≤ 0,0013 för att avbryta i förtid.

- Koll 3 (75 % av data): p-värdet måste vara ≤ 0,012 för att avbryta i förtid.

- Slutlig koll (100 % av data): p-värdet måste vara ≤ 0,043 för slutlig signifikans. (Notera hur det slutliga p-värdet är 0,043, vilket ligger mycket nära standardnivån 0,05!)

O’Brien-Fleming-metoden bevarar det slutliga p-värdet. Eftersom du “spenderar” väldigt lite av ditt alfa under de tidiga kontrollerna, ligger ditt tröskelvärde vid studiens slut fortfarande mycket nära 0,05. Dessutom förhindrar O’Brien-Fleming-metoden att studien avbryts i förtid. Tidigt i en studie kan data vara mycket instabila. Några tursamma framgångar kan få ett läkemedel att framstå som ett mirakelmedel. Det massiva hindret vid den första kollen (t.ex. p ≤ 0,00001) säkerställer att du bara avbryter studien i förtid om bevisen är absolut överväldigande. O’Brien-Fleming-gränsen bör vara din föredragna standardmetod för att testa en enskild primärvariabel vid olika tidpunkter medan en studie fortfarande pågår.

I vilket sammanhang bör jag justera signifikansnivån?

Signifikansnivån behöver sänkas om du presenterar flera p-värden. Men behöver jag ta hänsyn till alla p-värden som presenteras i en enskild tabell, alla p-värden i ett helt manuskript eller alla p-värden jag någonsin har beräknat i hela mitt liv? Om det sistnämnda vore sant skulle det innebära att alla erfarna statistiker skulle bli arbetslösa på grund av behovet av massiva justeringar av signifikansnivån.

Det är rimligt att justera för alla p-värden i ett manuskript som betraktas som faktiska resultat. P-värden beräknas ibland i korrelationer eller enkla regressioner enbart som en sorteringsmekanism för att avgöra vilka variabler som ska inkluderas i en slutgiltig multivariabel regression; dessa preliminära p-värden bör inte betraktas som resultat. Ett rimligt förslag kan vara att endast justera signifikansnivån för primära utfallsvariabler, en ståndpunkt som presenteras av Steve Grambow i denna video:

(Nedanstående video är på engelska. Om du har svårt att förstå engelska kan du få svensk text genom att klicka på “YouTube” (i nedre högra hörnet) för att gå till YouTube där videon automatiskt startar. I YouTube klickar du på kugghjulsikonen, sedan klicka på “Subtitles”, klicka sedan på auto-translate och välj svenska. Detta fungerar någorlunda bra men det kan bli en del felaktigheter i översättningen).